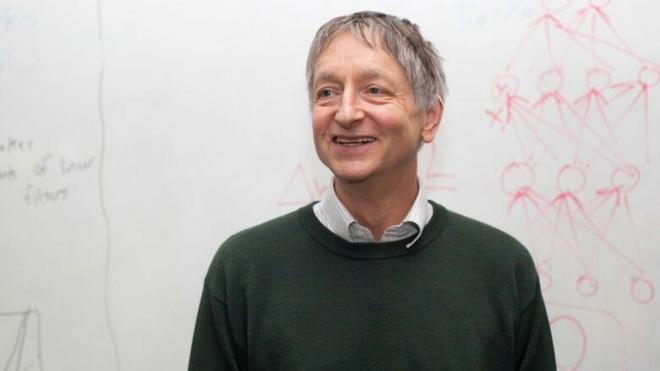

Geoffrey Hinton, "padrino de la inteligencia artificial": "En este momento los sistemas de IA no son más inteligentes que nosotros, pero creo que pronto lo serán"

- Redacción

- BBC News Mundo

Fuente de la imagen, Reuters

Geoffrey Hinton es conocido como "el padrino de la inteligencia artificial".

Fue pionero en la investigación de redes neuronales y aprendizaje profundo, que allanó el camino para el desarrollo de sistemas actuales de Inteligencia Artificial (IA) como ChatGPT.

En esta área tecnológica, las redes neuronales son sistemas similares al cerebro humano por la forma en que aprenden y procesan la información. Permiten que los sistemas de IA aprendan de la experiencia, como lo haría una persona. Esto se llama aprendizaje profundo.

Después de renunciar a su trabajo en Google, el informático británico-canadiense se atrevió a cuestionar públicamente la actual carrera entre compañías tecnológicas para desarrollar productos de IA.

Hinton, de 75 años, asegura que esta tecnología amenaza a la humanidad porque funciona mejor que el cerebro humano y nadie puede garantizar que podrá ser controlada.

A corto plazo, advierte de tres peligros: la creación de contenido digital cuya veracidad será imposible de comprobar para el "usuario promedio", el reemplazo de trabajadores en una amplia gama de oficios y que los sistemas de IA se conviertan un día en armas autónomas, especies de "robots asesinos".

En entrevista con la BBC, Hinton dijo que los chatbots podrían superar pronto el nivel de información que contiene un cerebro humano, avances que cree que son "bastante aterradores".

Fuente de la imagen, Getty Images

¿Por qué tomó la decisión de renunciar a Google y hacer estas críticas contra el desarrollo de la IA?

Había varias razones. Una es que tengo 75 años, así que es hora de retirarme.

Otra razón es que quiero decir algunas cosas buenas sobre Google y son más creíbles si no trabajo para ellos.

Y por último, quería tener la libertad de hablar sobre los peligros de la IA sin preocuparme por el impacto que pueda tener en Google.

Usted dijo que Google actuó de manera muy responsable. ¿Habría sido más efectivo su mensaje si hubiera estado dentro de la compañía, con la capacidad de dirigir las decisiones?

Pensé eso por un tiempo y puede ser cierto. Pero creo que ahora puedo hablar libremente sobre cuáles podrían ser los peligros y algunos de ellos son bastante aterradores.

Lo importante es que muchos buenos científicos han trabajado en el tema de cómo podemos controlar estas cosas si llegan a ser más inteligentes que nosotros.

¿Confía en las empresas de tecnología para avanzar sobre estos temas con responsabilidad?

Creo que un problema es que Microsoft decidió poner uno de estos chatbots avanzados en (el buscador) Bing y en otros productos y Google no tiene más remedio que responder a eso. No puede simplemente sentarse y no competir con Microsoft.

Antes de eso, Google estaba a la cabeza de la IA y optó por no publicar estas cosas debido a todos los peligros. Los usaron internamente para mejorar la búsqueda, pero en realidad no los dieron a conocer al público, a pesar de que tenían chatbots, debido a los peligros potenciales.

Creo que Google ha sido responsable en ese sentido. Pero sólo puedes hacer eso cuando estás a la cabeza. Si estás compitiendo con la compañía que está usando estas cosas, también tienes que usarlas.

Fuente de la imagen, Getty Images

Microsoft no llegó a esta tecnología por su cuenta. Usted ha sido parte de la investigación que condujo a este desarrollo durante años. ¿Quién es responsable de que la IA haya alcanzado el punto donde está ahora?

Somos científicos. Estamos explorando lo que sucede cuando entrenamos grandes redes neuronales de computadoras y por eso terminamos aquí.

Es una de esas cosas que no hay forma de que la gente no vaya a explorar. El problema es que ahora que descubrimos que funciona mejor de lo que esperábamos hace unos años, ¿qué hacemos para mitigar los riesgos a largo plazo? Cosas más inteligentes que nosotros tomando el control.

Hablemos de esos riesgos. Usted dijo que le preocupan los malos actores. ¿Qué es lo que más le inquieta con respecto a cómo se podría utilizar esta tecnología?

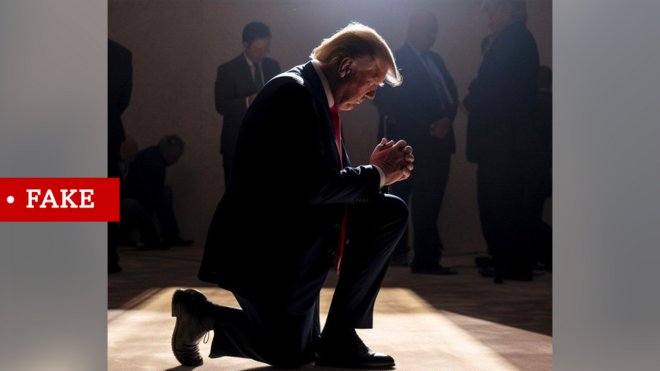

Se ha hablado mucho sobre la posibilidad de producir automáticamente textos con información falsa. Se pueden crear herramientas muy efectivas que permitan a líderes autoritarios manipular a sus electores, por ejemplo.

Pero quiero hablar en particular del riesgo existencial de lo que sucede cuando estas cosas se vuelven más inteligentes que nosotros. Recientemente llegué a la conclusión de que el tipo de inteligencia que desarrollamos es muy diferente de la inteligencia que tenemos.

Somos sistemas biológicos y estos son sistemas digitales. La gran diferencia con los sistemas digitales es que tienes muchas copias del mismo conjunto, del mismo modelo del mundo, y todas estas copias pueden aprender por separado pero comparten su conocimiento al instante.

Es como si tuviéramos 10.000 personas y cada vez que una aprende algo, todas las demás lo aprenden automáticamente. Así es como estos sistemas logran saber mucho más que el resto.

Fuente de la imagen, Google/Getty Images

Ha dicho que no sabemos exactamente cómo funciona el cerebro humano. ¿Cómo podemos estar seguros de que lo que acaba de describir eclipsa a la inteligencia humana?

No lo sabemos. En este momento lo que estamos viendo son cosas como que Chat GPT-4 eclipsa a una persona en la cantidad de conocimiento general.

En términos de razonamiento no es tan bueno, todavía no hace un razonamiento simple, pero dado el ritmo de progreso, presumimos que las cosas mejoren bastante rápido. Así que tenemos que preocuparnos por eso.

En este momento (los sistemas de IA) no son más inteligentes que nosotros, pero creo que pronto lo serán.

¿Qué pasa con las oportunidades que ofrece esta tecnología? Por ejemplo, para detectar enfermedades mejor que lo que pueden hacer los médicos humanos.

Esa es una de las razones por las que he estado trabajando en IA tanto tiempo, porque va a ser extremadamente beneficioso para cosas como esa.

La capacidad de estos grandes chatbots de saber mucho más que nadie los haría mejores que el médico de familia estándar. Serían como un médico que ha visto a diez millones de pacientes y probablemente esté viendo a muchos con los mismos problemas por los que tú acudes al médico.

¿Cuál es el equilibrio entre el riesgo y el beneficio?

A corto plazo, creo que obtenemos muchos más beneficios que riesgos. No creo que debamos dejar de desarrollar estas cosas (...) Ver sus usos puede ser muy beneficioso y eso alentará a las personas a seguir desarrollándola.

Pero debemos pensar detenidamente en cómo podemos desarrollarla sin que pueda ser controlada.

Fuente de la imagen, Getty Images

Algunos de sus antiguos alumnos y expertos en la industria dicen que los riesgos que está describiendo son hipotéticos. ¿Dónde estamos ahora? ¿Hemos ido ya demasiado lejos con esta tecnología?

No lo sabemos. Creo que si dejas de desarrollarla ahora, este riesgo existencial se mitigaría. No creo que las cosas permanezcan como están. Obviamente vamos a desarrollar mucho más porque (estos sistemas) son muy útiles. Y luego tenemos que preocuparnos por lo que va a pasar.

Hago esta reflexión públicamente para alentar a las personas a pensar muy en serio sobre lo que van a hacer para asegurarse de que si desarrollamos cosas más inteligentes que nosotros, esas cosas no tomen el control.

¿Podría darnos una idea, quizás no a corto pero sí a más largo plazo, de cómo podría verse la IA dentro de nuestras vidas?

Me refiero a este como el peor de los casos, el escenario de la pesadilla. Puedes imaginar, por ejemplo, a algún mal actor como (Vladimir) Putin decidiendo dar a los robots la capacidad de crear sus propios subobjetivos.

¿Qué significa esto? Tengo un objetivo, por ejemplo, llegar al aeropuerto. Luego debo configurar el subobjetivo de conseguir un taxi, por lo que mi subobjetivo es llamar a un Uber.

La capacidad de crear subobjetivos hace que los agentes sean mucho más efectivos. Así que le darás a los soldados robots la capacidad de crear subobjetivos. Pero una vez que haces eso, entonces pueden crear subobjetivos como "necesito obtener más poder", porque si obtienen más poder, podrán lograr mejor sus objetivos.

Ves esto incluso en bebés con sus madres. La madre le da al bebé la cuchara para que se alimente solo. El bebé deja caer la cuchara al suelo para que la madre la recoja y se la devuelva. El bebé vuelve a dejarla caer al suelo para ver si logra que la madre la recoja de nuevo. Intenta controlar a su madre.

Estas son empresas privadas en competencia por trabajar con esta tecnología. ¿Qué pueden hacer las autoridades para cambiar la dirección de los acontecimientos si hay un problema?

Soy un experto en la ciencia, no en política. Lo que diga sobre esto no proviene de una experticia, pero debe haber algo que puedan hacer. Tiene que ser el gobierno el que desarrolle (esta tecnología) con mucha reflexión sobre cómo detenerla si se rebela.

Fuente de la imagen, Getty Images

Recuerda que puedes recibir notificaciones de BBC Mundo. Descarga la nueva versión de nuestra app y actívalas para no perderte nuestro mejor contenido.